数字が物語る現実は厳しいものです。大学生の56%が、課題や試験でAIツールを使用したことを認めており、AI関連の学術不正はわずか2年で3倍に増加しています。これはもはや「ほんの一部の悪いリンゴ」の問題ではなく、学生の学習への向き合い方、そして率直に言えば、教師の教え方そのものを再構築する事態となっています。

しかし、ひとつ言えるのは、AIはここから消えるものではない、ということです。本当の問いは、学生がこれらのツールを使うかどうかではなく、教育の健全性を守りながら、責任ある使い方をどのように指導するかです。学生がAIを使ってシステムを不正利用する最も一般的な5つの方法と、さらに重要な、実際に私たちにできる対策について掘り下げてみましょう。

- 学生がAIでカンニングする5つの方法と防止策

- AIによるレポート・課題作成:即席論文工場

- 問題解決のためのAI:強化版宿題ヘルパー

- AIによる言い換え:盗作の新しい仮面

- オンラインテスト中のAI利用:デジタルカンニングの蔓延

- 完全な「ゴーストライター」としてのAI:プロジェクトが自分で書かれる時

- 反撃するテクノロジー:OnlineExamMakerのAI監視ソリューション

- 最後に:新たな現実に適応する

学生がAIでカンニングする5つの方法と防止策

1. AIによるレポート・課題作成:即席論文工場

正直に言いましょう―その魅力は否定できません。学生がChatGPTに「沿岸生態系への気候変動の影響について1500語のエッセイを書いて」と入力すると、30秒後にはB+評価レベルの論文に見えるものが出来上がります。いくつか言葉を変え、個人的な逸話を追加すれば、出来上がり―宿題完了です。

調査によると、AIツールを使用する学生の89%が宿題課題に利用しており、エッセイが主なターゲットです。現代の学業環境―締切の競合、アルバイト、課外活動―は、その即時の満足感をほとんど抵抗できないものにしています。留学生の言語障壁や、悪い成績への恐怖が加われば、AIを利用した近道を選ぶ完璧な環境が整います。

なぜ魅力的なのか

しかし、時間的圧力だけがすべてを説明するわけではありません。学術的な文章作成―議論の構築、思考の整理、自分自身の声(スタイル)を見つけること―に本当に苦労している学生もいます。AIは、彼らにとって命綱のように感じられるものを提供します。他の学生は単に害があるとは考えていません。結局のところ、みんな数学に電卓を使うじゃないか、と彼らは理由づけします。

実際に効果のある防止策

反射的に「AIを禁止する」や「厳罰をちらつかせる」といった対応は、ほとんど効果がありません。学生は回避策を見つけ、振り出しに戻ってしまいます。代わりに、以下のアプローチを試してみてください。

AIが偽造できない課題をデザインする。「ハムレットの主題について論じなさい」のような一般的な指示は、AIにとってはお菓子のようなものです。代わりに、授業内容を学生の個人的な経験、地域の出来事、または授業でのディスカッション観察と結びつけるよう求めましょう。「ハムレットの優柔不断さは、あなたが直面した困難な決断とどのように比較できますか?」これはチャットボットに外注するのが難しい問いです。

プロセスを可視化する。 学生に、段階的に(アウトライン、教師のコメント付きの草稿、修正メモなど)成果物を提出するよう求めます。学生が自身の論文と主な論点を説明する短い1対1の対話をスケジュールします。もし彼らが自分の考えを明確に説明できなければ、それは危険信号です。文章作成における「計算式を書く」ようなものと考えてください。

AIリテラシーを受け入れる。 ここに革新的な考え方があります:学生にAIを正当なツールとして使うことを教えるのです。AIにエッセイを生成させ、それをクラス全体で批評し合います。何が欠けているか?深みがどこに足りないか?どの情報源をでっち上げたか?これにより、AIは敵から教育的な瞬間へと変わります。

2. 問題解決のためのAI:強化版宿題ヘルパー

数学、物理、プログラミング、統計―ステップバイステップの解答が存在するあらゆる分野が、今や脆弱です。学生が微積分の問題を撮影し、AIツールにアップロードすると、答えだけでなく、その解き方の完全な内訳を受け取ります。教育的に聞こえますね?

落とし穴は?学生は、基礎となる概念を理解せずに解答をコピーすることが多いのです。彼らは自分自身の問題解決能力(筋力)を発達させるのではなく、他人(まあ、AIのシリコンブレイン)の頭脳を借りているのです。研究によると、39%から48%の学生が、特にSTEM分野で、問題解決タスクにAIツールを使用しています。

より深い問題

試験の時期が来たとき―特にデバイス使用不可の対面試験では―これらの学生は壁にぶつかります。彼らは実際には問題解決のプロセスを学んだことがないのです。基本的な原理を理解せず、AIの解答からパターンを暗記しただけです。動画を見て運転を学ぶようなものです。理論は理解できるかもしれませんが、実技試験はおそらく上手くいかないでしょう。

本当のスキルを構築する防止策

文脈に特化した問題を使用する。 一般的な教科書の問題?AIにとっては簡単な獲物です。代わりに、地域のデータ、学校の統計、コミュニティの情報を使った問題を作成します。「体育館で収集したデータを使って、本校のバスケットボールのフリースローの投射運動を計算しなさい。」AIは投射運動を説明できますが、あなたの学校固有の測定値をでっち上げることはできません。

頻繁な低リスク評価を取り入れる。 小テストは評判が良くないですが、ここにその秘密兵器があります:実際に学習している人と、AIに外注している人を明らかにするのです。短く保ち、個々の配点を小さくし、公式の暗記ではなく概念の応用に焦点を当てます。学生がデバイスなしで基本的な問題を解けないなら、それは学習のギャップを特定したことになります。

思考を明らかにする作業過程の提示を求める。 最終的な答えだけを評価しないでください。特定の方法を選んだ理由を含め、各ステップの詳細な説明を要求します。さらに良いのは、「あなたの推論を説明しなさい」という質問を含めることです。AIは計算できますが、学生らしい思考過程の説明を模倣するのはあまり得意ではありません。

3. AIによる言い換え:盗作の新しい仮面

これは巧妙です。学生は完璧な記事を見つけるか、友人の古い論文を使い、それをAIの言い換えツールに入力すると、盗作チェッカーをかいくぐる「独自の」文章が出てきます。アイデアは?盗用です。言葉は?技術的には異なります。倫理違反は?完全に現実ですが、証明するのは難しい。

教育者にとって最も悩ましいのは、多くの学生がこれをカンニングと認識さえしていないことです。彼らは言葉を変えることで盗作が許容される行為に変わると、心から信じています。彼らにとっては抜け穴であり、自分たちにとって都合の良いグレーゾーンを白だと信じ込ませているのです。

倫理観の断絶

問題の一部は、一貫性のない、または不明確な学術方針にあります。学生の約60%が、自分の学校がAIツールを倫理的または責任を持って使用する方法を具体的に示していないと報告しています。ルールが曖昧なとき、学生は自分たちの当面のニーズに役立つもので空白を埋めます。私たちが作った曖昧さを利用することを、本当に彼らを責めることはできません。

明確さと実践による防止

水晶のように明確な引用方針を確立する。 学生がAI時代において何が盗作となるかを知っていると想定しないでください。明示的なガイドラインを作成します:「もし情報源の言い換えにAIを使用した場合は、元の情報源を引用し、かつAIが言い換えを支援したことを記述してください。」これらのルールをアクセスしやすくし、定期的に議論し、課題の指示に含めます。

足場をかけた練習を通じてスキルを構築する。 1つの大きな研究論文を割り当てる代わりに、構成要素に分解します:情報源を見つける、それぞれを自分の言葉で要約した注釈を書く、文中引用付きでセクションを草稿する、最終論文に統合する。このステップバイステップのアプローチは、AIによる近道の魅力を減らし、真の研究スキルを育成します。

要約よりも解釈に焦点を当てる。 AIが容易に複製できない、学生の声と批判的分析を必要とする課題を割り当てます。「この記事を要約しなさい」はAIによる言い換えを誘引します。「この記事の方法論を批評し、改善策を提案しなさい」は、AIが簡単に複製できない独自の思考を要求します。

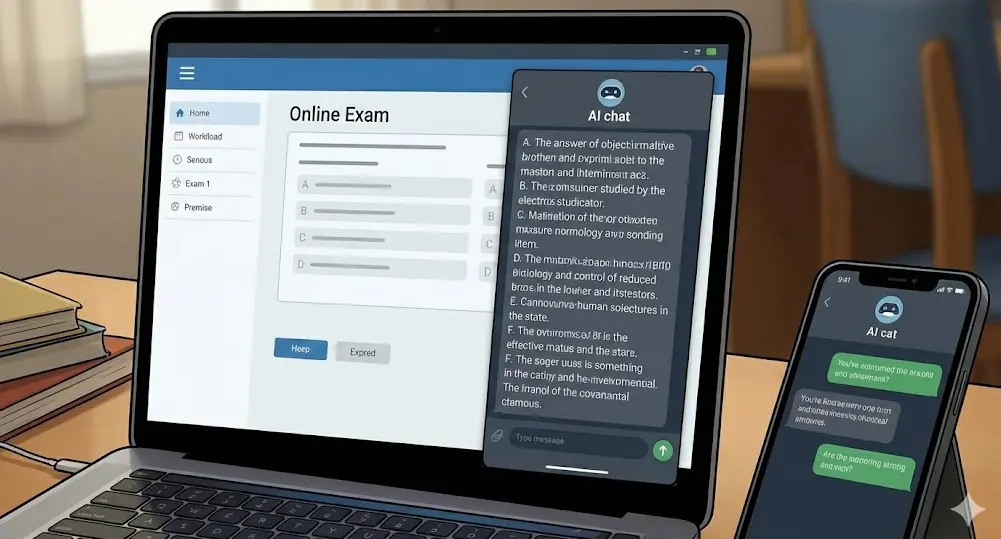

4. オンラインテスト中のAI利用:デジタルカンニングの蔓延

監督なしのオンライン試験は無法地帯となっています。学生は別のウィンドウでAIチャットボットを開いたままにし、問題をスクリーンショットするか、単にAIで拡張された検索エンジンにクエリを入力します。複数のデバイスはそれをさらに容易にします―試験用のノートパソコン、AI相談用のスマートフォン。

統計は厳しいものです:AI関連の学術不正は現在、世界中の高等教育機関におけるすべてのカンニング事例の60〜64%を占めています。これは従来の盗作パターンからの地殻変動であり、わずか2年の間に起こったことです。

いたちごっこ

ここに不快な真実があります:検出は困難です。AI検出ツールは存在しますが、誠実な学生を不当に罰する可能性のある誤検知率があり、完璧とは程遠いものです。一方、学生は教育者が適応するよりも速く、回避策やテクニックを共有します。これは誰も勝者とならないいたちごっこです。

賢い評価設計による防止

頻繁で、リスクの低いテストを実施する。 1つの高リスクの期末試験は、カンニングへの膨大な圧力を生み出します。個々の配点が小さい10回の小テストではどうでしょう?学生はそれほど必死にならず、各評価中にAIに相談する時間も少なくなり、教師は彼らの継続的な学習についてより良いデータを得られます。おまけ:頻繁なテストは、テスト効果を通じて実際に記憶の保持を向上させます。

評価方法を組み合わせる。 オンラインテストを他の評価形態と組み合わせます:ビデオ通話による短い口頭試問、プロジェクト発表、実践的デモンストレーション。テストの成績が怪しいほど高いのに、プレゼンスキルが遅れている場合、その不一致は重要なことを語っています。

高度な監視技術を使用する。 これは、AI時代のために設計された専門的なソリューションにつながります。後から探偵ごっこをするよりも、評価中の防止策の方が効果的であり、かつ公正です。

5. 完全な「ゴーストライター」としてのAI:プロジェクトが自分で書かれる時

AIカンニングの中で最も包括的な形態:学生はチャットボットを使って、プロジェクトのコンセプト全体、アウトライン、スクリプト、プレゼンテーションスライド、スピーカーノートを生成します。いくつかの詳細をカスタマイズし、自分の名前を挿入し、本質的に自分が作成していない作品を提出するかもしれません。

その仕上がりは印象的―おそらく不自然なほどに。授業中のディスカッションに苦労していた学生が、突然洗練された分析を提出します。危険信号は揺らめきますが、それを証明するのは?それもまた別の挑戦です。

隠れた結果

明白な学術的不正行為を超えて、これらの学生は自分自身から学習の機会を奪っています。プロジェクトは、計画、研究、統合、コミュニケーション―職業的成功に不可欠なスキルを教えます。AIが重労働をするとき、学生は能力なくして資格だけを手に卒業します。就職市場は教室ほど寛大ではありません。

真正な評価による防止

一次調査とデータ収集を要求する。 地域住民へのインタビュー、フィールドワーク観察、または独自のアンケートを要求するプロジェクトをデザインします。AIはデータ分析を助けることができますが、あなたの隣人にインタビューしたり、地域の現象を記録したりすることはできません。真正な研究は、真正な学習を生み出します。

内省とメタ認知を組み込む。 学生にそのプロセスを記録するよう求めます:どのAIツールを、どの目的で使用しましたか?どの提案を拒否し、その理由は?あなたの考えはどのように進化しましたか?この透明性は二重の目的に役立ちます―責任あるAIの使用法を教え、実際に教材に取り組んでいる人を明らかにします。

発表と弁明形式を採用する。 プロジェクト提出後、学生が自分の作品を説明し、質問に答える短いセッションをスケジュールします。本当に自分のプロジェクトを作成した人は、方法論について議論し、選択を弁護し、発見を詳しく説明できます。AIからコピーした人は?表面的な理解を超えて迫られると、つまずくでしょう。

反撃するテクノロジー:OnlineExamMakerのAI監視ソリューション

教育学的戦略が第一の防衛線を形成する一方で、テクノロジーはこれらの努力を強化することができます―特にオンライン評価において。OnlineExamMakerは、デジタル時代において試験の健全性を維持するために特別に設計された、包括的なAI駆動の監視システムを提供します。

OnlineExamMakerでAIを使って次のクイズ/試験を作成する

OnlineExamMakerが学術的誠実性を保護する方法

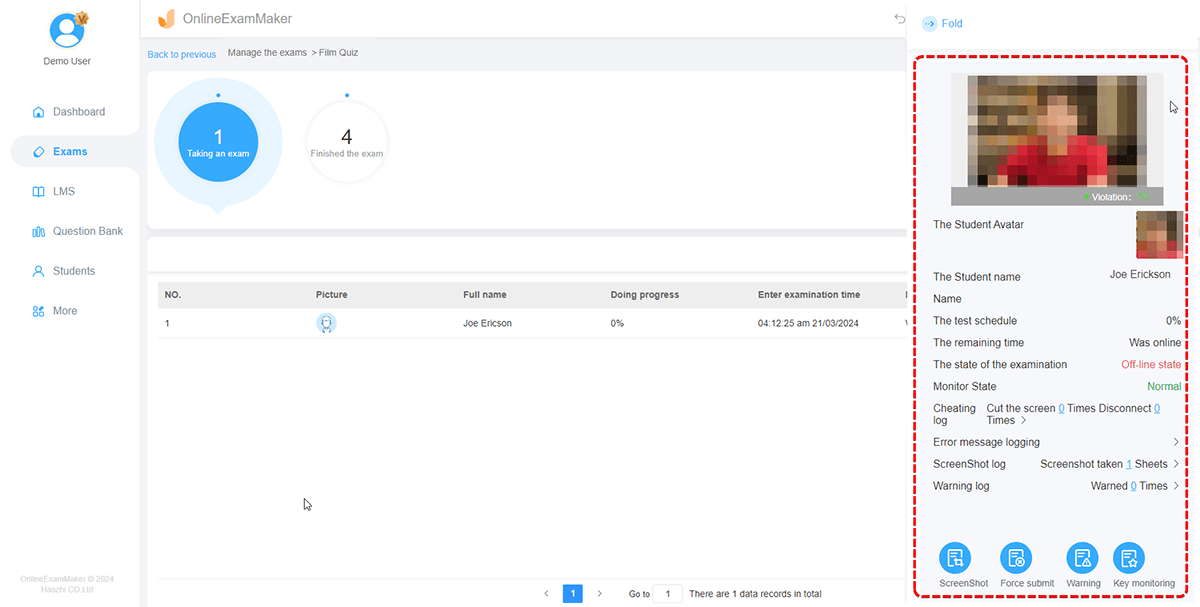

顔認証技術: システムは、受験者の身元を確認するためにAIを活用した顔認証を使用します。試験開始前に、学生はプロフィール写真をアップロードします。その後、システムは試験中にウェブカメラ経由で画像をキャプチャし、保存された写真と比較して、代理人による受験を防止します。

360度ウェブカメラ監視: リアルタイムビデオ監視が受験プロセス全体をキャプチャします。AIは行動パターンを分析し、以下のような不審な活動を検出します:

- 頭を下げる、または背を向ける(隠し資料を読んでいる可能性)

- 画面に複数の顔が映る(不正な支援)

- 長時間顔が検出されない(学生が試験エリアを離れた)

- 音声によるコミュニケーションまたは音声起動型AIの使用のための音声検出

- 顔マッチングの失敗(登録された学生以外の人物が試験を受けている)

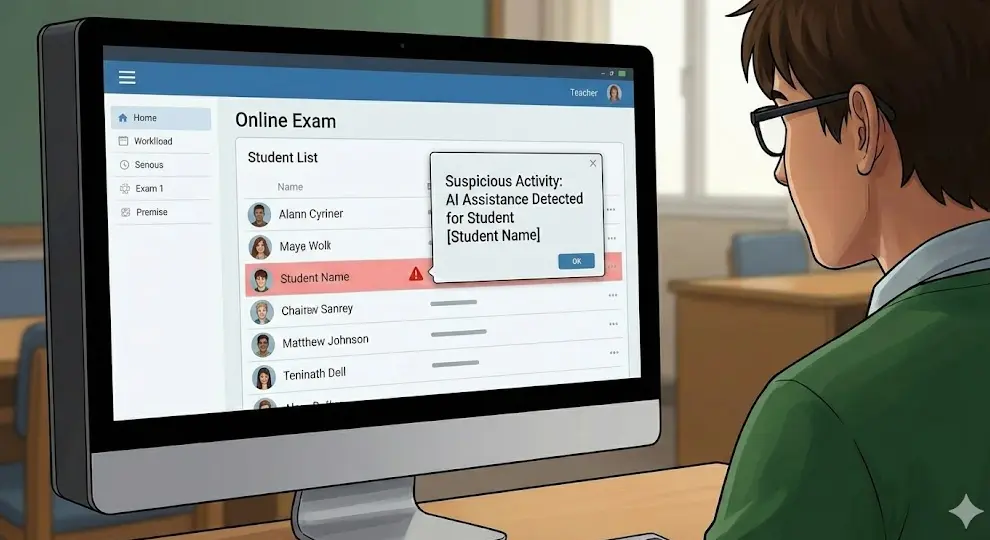

インテリジェントアラートシステム: 管理者は不審な行動の閾値を設定します。もし学生がこの限度を超えた場合―例えば、5回以上よそ見をした―システムは自動的に彼らの試験を提出するか、監督者に介入を警告することができます。

ロックダウンブラウザ機能: プラットフォームは全画面モードを強制し、学生が追加のウィンドウ、タブ、またはアプリケーションを開くことを防止します。画面切り替えの試みを検出し、学生が試験インターフェースを離れる回数を制限することができます。

ランダム化ツール: 解答の共有を防止するために、OnlineExamMakerは問題のランダム化(問題バンクからの抽出)、順序のランダム化(問題順序のシャッフル)、選択肢のランダム化(多肢選択問題の解答の並び替え)を提供します。各学生は独自の試験構成を見ます。

リアルタイム監視ダッシュボード: 管理者は一元化されたコンソールを通じて、すべてのアクティブな受験者を同時に監視し、ライブのウェブカメラ映像を視聴し、不審な活動に対する即時アラートを受け取ることができます。試験後は、詳細なログとキャプチャされた画像がレビューのための証拠を提供します。

導入のベストプラクティス

テクノロジーだけでは万能薬ではありません。最大限の効果のために、OnlineExamMakerは、学生が試験開始30分前にログインしてウェブカメラをテストし、照明を調整し、顔認証を完了できるようにすることを推奨しています。これにより、技術的な問題が原因で誠実な学生が身元確認に失敗することを防ぎます。

このシステムはまた、教育者が効果的であると見出した様々な評価戦略をサポートしています:問題ごとの時間制限(AIに相談する機会を減らす)、長時間オフライン後の自動提出、同じアカウントからの複数同時ログインを防止する制限などです。

最も重要なのは、監視対策について学生と明確にコミュニケーションを取ることで信頼を構築することです。何が、なぜ監視されているのかを学生が理解するとき、彼らはこれらの安全策を侵入的ではなく公正なものとして受け入れやすくなります。透明性が重要です。

最後に:新たな現実に適応する

少し引いて考えてみましょう。私たちは教育における根本的な変化を目撃しています。電卓がどこにでもあるようになった時や、インターネットが情報を普遍的にアクセス可能にした時と似ています。その都度、教育者は適応しました―技術を禁止するのではなく、何を、どのように教えるかを変えることで。

同じことがAIにも当てはまります。調査によると、指導者の68%が生成AIが学術的誠実性に悪影響を与えると信じていますが、その視点は大きな絵を見逃しているかもしれません。AIは学生をカンニングさせているのではなく、私たちが学習を評価する方法の弱点を露呈させているのです。

もしAIがあなたのテストや課題を優秀な成績で通過できるなら、そのテストや課題はおそらく理解ではなく暗記、批判的思考ではなく再生産を測定していたのかもしれません。解決策は、AIとの戦争を仕掛けること―私たちが必然的に負ける戦争―ではなく、AIが複製できないスキル:創造性、倫理的推論、独自の研究、個人的な洞察、実世界での応用を中心に評価を再設計することです。

ここにパラドックスがあります:学生は責任を持ってAIを使うことを学ぶ必要があります。なぜなら、彼らの将来のキャリアはおそらくそれを要求するからです。世界経済フォーラムは、AIリテラシーを重要な労働力スキルとして挙げています。ですから、私たちはAIのない世界のために彼らを準備しているのではなく、いつ、どのようにこれらのツールを使うかについて判断力が必要な、AIが統合された世界のために彼らを準備しているのです。

それはつまり、明確な方針、そうです。高リスク試験に対する堅牢な監視、もちろんです。しかし、より根本的には、教育において何を価値あるとするかを再考することを意味します。プロセス対成果物。思考対解答。成長対成績。

今日あなたの教室にやって来る学生たちは、AIによって変容した世界に卒業していきます。あなたの仕事は、彼らをその現実から遮断することではなく、誠実さ、批判的思考、そして真の能力を持ってそれを乗り越えるための装備を彼らに与えることです。カンニング問題は現実ですが、それはまた機会でもあります―私たちが以前持っていたものよりも良い何かを構築するための招待状なのです。

結局のところ、教育は常にカンニングを防止すること以上のものでした。それは学びを鼓舞することです。そしてAIの時代において、その使命はこれまで以上に重要です。