Les chiffres racontent une histoire qui donne à réfléchir. 56 % des étudiants universitaires admettent utiliser des outils d’IA pour leurs devoirs ou examens, et le taux de fautes académiques liées à l’IA a triplé en seulement deux ans. Nous ne parlons plus de quelques brebis galeuses — cela redéfinit la façon dont les étudiants abordent l’apprentissage, et franchement, la façon dont les enseignants doivent aborder l’enseignement.

Voici la chose, cependant : l’IA ne va pas disparaître. La vraie question n’est pas de savoir si les étudiants utiliseront ces outils, mais comment les guider pour qu’ils les utilisent de manière responsable tout en protégeant l’intégrité de l’éducation. Plongeons dans les cinq moyens les plus courants par lesquels les étudiants contournent le système avec l’IA, et plus important encore, ce que vous pouvez réellement faire.

- 5 façons dont les étudiants trichent avec l’IA et méthodes pour l’empêcher

- Dissertations et devoirs écrits par l’IA : L’usine à copies instantanée

- IA pour la résolution de problèmes : L’aide aux devoirs dopée

- Paraphrase par l’IA : Le nouveau déguisement du plagiat

- IA pendant les tests en ligne : L’épidémie de triche numérique

- IA comme “nègre” à part entière : Quand les projets s’écrivent tout seuls

- La technologie contre-attaque : La solution de surveillance par IA d’OnlineExamMaker

- Réflexions finales : S’adapter à une nouvelle réalité

5 façons dont les étudiants trichent avec l’IA et méthodes pour l’empêcher

1. Dissertations et devoirs écrits par l’IA : L’usine à copies instantanée

Soyons honnêtes — l’attrait est indéniable. Un étudiant tape “Écris-moi une dissertation de 1 500 mots sur l’impact du changement climatique sur les écosystèmes côtiers” dans ChatGPT, et trente secondes plus tard, il a quelque chose qui ressemble remarquablement à un devoir de niveau B+. Peut-être change-t-il quelques mots ici, ajoute une anecdote personnelle là, et voilà — les devoirs sont faits.

Les recherches montrent que 89 % des étudiants qui utilisent des outils d’IA les déploient pour des devoirs, les dissertations étant la cible principale. La pression constante du milieu académique moderne — échéances concurrentes, emplois à temps partiel, activités extrascolaires — rend cette gratification instantanée presque irrésistible. Ajoutez des barrières linguistiques pour les étudiants internationaux ou la peur paralysante d’une mauvaise note, et vous avez la tempête parfaite pour les raccourcis assistés par l’IA.

Pourquoi c’est tentant

La pression du temps n’explique pas tout, cependant. Certains étudiants ont vraiment du mal avec l’écriture académique — construire des arguments, organiser leurs pensées, trouver leur voix. L’IA offre ce qui ressemble à une bouée de sauvetage. D’autres ne voient tout simplement pas le mal ; après tout, raisonnent-ils, tout le monde n’utilise-t-il pas des calculatrices pour les maths ?

Stratégies de prévention qui fonctionnent vraiment

La réaction instinctive — interdire l’IA ou menacer de sanctions sévères — fonctionne rarement. Les étudiants trouvent des solutions de contournement, et vous revenez à la case départ. Essayez plutôt ces approches :

Concevez des devoirs que l’IA ne peut pas imiter. Les sujets génériques comme “Discutez des thèmes dans Hamlet” sont du sucre pour l’IA. Demandez plutôt aux étudiants de relier le contenu du cours à leurs expériences personnelles, à des événements locaux ou à des observations issues des discussions en classe. “En quoi l’indécision d’Hamlet se compare-t-elle à un choix difficile que vous avez dû faire ?” C’est plus difficile à externaliser vers un chatbot.

Rendez le processus visible. Exigez que les étudiants soumettent leur travail par étapes — plans, brouillons avec vos commentaires, notes de révision. Planifiez de brèves conversations individuelles où les étudiants expliquent leur thèse et leurs principaux arguments. S’ils ne peuvent pas articuler leurs propres idées, c’est votre signal d’alarme. Voyez cela comme montrer ses calculs, mais pour l’écriture.

Adoptez la littératie en IA. Voici une idée radicale : apprenez aux étudiants à utiliser l’IA comme un outil légitime. Faites-leur générer une dissertation par IA, puis critiquez-la ensemble en classe. Qu’est-ce qui manque ? Où manque la profondeur ? Quelles sources a-t-elle inventées ? Cela transforme l’IA d’ennemie en opportunité d’apprentissage.

2. IA pour la résolution de problèmes : L’aide aux devoirs dopée

Maths, physique, programmation, statistiques — tout domaine avec des solutions étape par étape est maintenant vulnérable. Les étudiants photographient un problème de calcul différentiel, le téléchargent dans un outil d’IA et reçoivent non seulement la réponse mais aussi une explication complète de la manière de le résoudre. Cela semble éducatif, non ?

Le piège ? Les étudiants copient souvent les solutions sans comprendre les concepts sous-jacents. Ils empruntent le cerveau de quelqu’un d’autre (enfin, le cerveau de silicium d’une IA) plutôt que de développer leurs propres muscles de résolution de problèmes. La recherche indique qu’entre 39 % et 48 % des étudiants utilisent des outils d’IA pour des tâches de résolution de problèmes, particulièrement dans les domaines des STEM.

Le problème plus profond

Lorsque l’heure des examens arrive — particulièrement les examens en présentiel sans accès aux appareils — ces étudiants se heurtent à un mur. Ils n’ont jamais réellement appris le processus de résolution de problèmes. Ils ont mémorisé des modèles à partir des solutions de l’IA sans saisir les principes fondamentaux. C’est comme apprendre à conduire en regardant des vidéos ; vous pourriez comprendre la théorie, mais bon courage pour votre examen de conduite.

Stratégies de prévention qui développent de vraies compétences

Utilisez des problèmes spécifiques au contexte. Les questions génériques des manuels scolaires ? Du miel facile pour l’IA. Créez plutôt des problèmes utilisant des données locales, des statistiques de l’école ou des informations de la communauté. “Calculez le mouvement parabolique d’un lancer franc de basket-ball de notre école en utilisant des données que vous collectez dans le gymnase.” L’IA peut expliquer le mouvement parabolique, mais elle ne peut pas fabriquer les mesures spécifiques de votre école.

Incorporez des évaluations fréquentes à enjeux limités. Les quiz surprises ont mauvaise réputation, mais voici leur atout secret : ils révèlent qui apprend réellement par rapport à qui externalise vers l’IA. Gardez-les courts, faites qu’ils valent peu individuellement et concentrez-vous sur l’application des concepts plutôt que sur la mémorisation de formules. Si les étudiants ne peuvent pas résoudre des problèmes de base sans leurs appareils, vous avez identifié une lacune dans l’apprentissage.

Exigez la présentation du travail qui révèle la réflexion. Ne notez pas seulement la réponse finale. Exigez des explications détaillées de chaque étape, y compris pourquoi ils ont choisi des méthodes particulières. Mieux encore, incluez des questions “expliquez votre raisonnement”. L’IA peut calculer ; elle est moins apte à imiter la voix authentique d’un étudiant expliquant son processus de pensée.

3. Paraphrase par l’IA : Le nouveau déguisement du plagiat

Celui-ci est sournois. Un étudiant trouve un article parfait ou utilise un ancien devoir d’un ami, le donne à un outil de paraphrase par IA, et en ressort un texte “original” qui esquive les détecteurs de plagiat. Les idées ? Empruntées. Les mots ? Techniquement différents. La violation éthique ? Absolument réelle, mais plus difficile à prouver.

Ce qui trouble le plus les éducateurs, c’est que de nombreux étudiants ne reconnaissent même pas cela comme de la triche. Ils croient sincèrement que changer la formulation transforme le plagiat en une pratique acceptable. C’est une faille dans leur esprit, une zone grise qu’ils se sont convaincus être blanche.

La déconnexion éthique

Une partie du problème réside dans des politiques académiques incohérentes ou floues. Environ 60 % des étudiants rapportent que leurs écoles n’ont pas spécifié comment utiliser les outils d’IA de manière éthique ou responsable. Lorsque les règles sont floues, les étudiants comblent les blancs avec ce qui sert leurs besoins immédiats. On ne peut pas vraiment leur en vouloir d’exploiter une ambiguïté que nous avons créée.

Prévention par la clarté et la pratique

Établissez des politiques de citation cristallines. Ne supposez pas que les étudiants savent ce qui constitue du plagiat à l’ère de l’IA. Créez des directives explicites : “Si vous avez utilisé l’IA pour paraphraser une source, citez à la fois la source originale ET notez que l’IA a aidé à la paraphrase.” Rendez ces règles accessibles, discutez-en régulièrement et incluez-les dans les consignes des devoirs.

Développez les compétences par une pratique échafaudée. Au lieu d’attribuer un seul gros travail de recherche, divisez-le en composants : trouver des sources, écrire des annotations résumant chacune dans vos propres mots, rédiger des sections avec des citations dans le texte, synthétiser en un document final. Cette approche étape par étape rend les raccourcis par IA moins attrayants et développe de véritables compétences en recherche.

Concentrez-vous sur l’interprétation plutôt que sur le résumé. Attribuez des tâches nécessitant la voix de l’étudiant et une analyse critique plutôt qu’une régurgitation d’informations. “Résumez cet article” invite à la paraphrase par IA. “Critiquez la méthodologie de cet article et proposez des améliorations” exige une pensée originale que l’IA ne peut pas facilement reproduire.

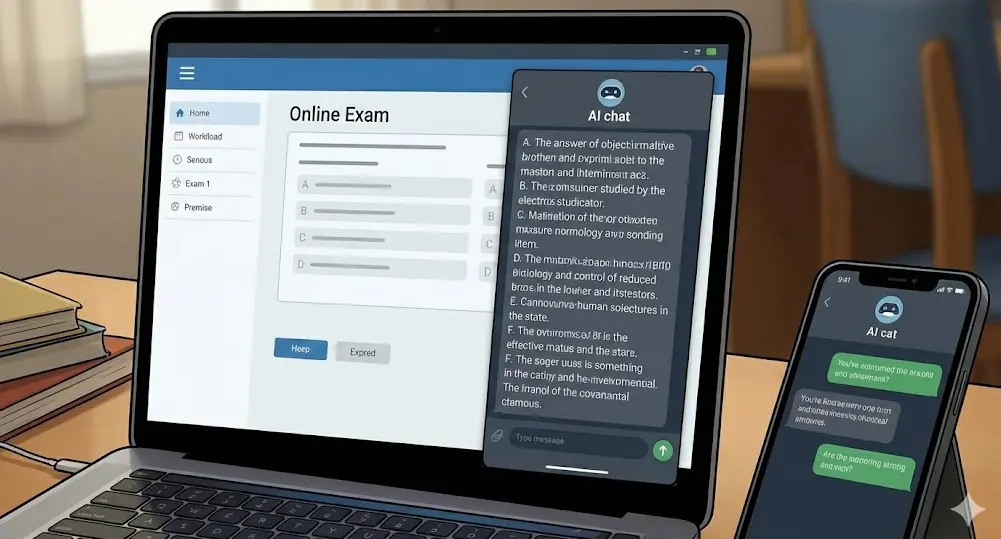

4. IA pendant les tests en ligne : L’épidémie de triche numérique

Les examens en ligne non surveillés sont devenus un libre-service. Les étudiants gardent des chatbots d’IA ouverts dans une autre fenêtre, font des captures d’écran des questions, ou tapent simplement des requêtes dans des moteurs de recherche augmentés par l’IA. Les appareils multiples rendent cela encore plus facile — ordinateur portable pour l’examen, téléphone pour la consultation de l’IA.

Les statistiques sont nettes : les fautes académiques liées à l’IA représentent maintenant 60 à 64 % de tous les cas de triche dans les établissements d’enseignement supérieur à l’échelle mondiale. C’est un changement sismique par rapport aux schémas de plagiat traditionnels, et cela s’est produit en l’espace de seulement deux ans.

La course aux armements

Voici une vérité inconfortable : la détection est difficile. Des outils de détection de l’IA existent, mais ils sont loin d’être parfaits, avec des taux de faux positifs qui peuvent pénaliser injustement les étudiants honnêtes. Pendant ce temps, les étudiants partagent des solutions de contournement et des techniques plus vite que les éducateurs ne peuvent s’adapter. C’est une course aux armements que personne ne gagne.

Prévention par une conception intelligente de l’évaluation

Mettez en œuvre des tests fréquents, à enjeux limités. Un seul examen final à enjeux élevés crée une pression énorme pour tricher. Dix petits quiz valant moins individuellement ? Les étudiants se sentent moins désespérés, ont moins de temps pendant chaque évaluation pour consulter l’IA, et vous obtenez de meilleures données sur leur apprentissage en cours. Bonus : des tests fréquents améliorent en fait la rétention grâce à l’effet de test.

Mélangez les méthodes d’évaluation. Combinez des tests en ligne avec d’autres formes d’évaluation : courts examens oraux via appel vidéo, présentations de projets, démonstrations pratiques. Si la performance aux tests semble suspectement élevée mais que les compétences de présentation sont à la traîne, cette divergence vous dit quelque chose d’important.

Utilisez une technologie de surveillance avancée. Cela nous amène à des solutions spécialisées conçues pour l’ère de l’IA. Plutôt que de jouer les détectives après coup, la prévention pendant l’évaluation est plus efficace — et plus équitable.

5. IA comme “nègre” à part entière : Quand les projets s’écrivent tout seuls

La forme la plus complète de triche par IA : les étudiants utilisent des chatbots pour générer des concepts de projets entiers, des plans, des scripts, des diapositives de présentation et des notes d’orateur. Ils peuvent personnaliser quelques détails, insérer leur nom et présenter un travail qu’ils n’ont fondamentalement pas créé.

Le polissage peut être impressionnant — peut-être suspectement. Un étudiant qui a des difficultés dans les discussions en classe livre soudainement une analyse sophistiquée. Des drapeaux rouges s’agitent, mais le prouver ? C’est un autre défi entièrement.

Les conséquences cachées

Au-delà de la malhonnêteté académique évidente, ces étudiants se privent d’opportunités d’apprentissage. Les projets enseignent la planification, la recherche, la synthèse, la communication — des compétences cruciales pour la réussite professionnelle. Lorsque l’IA fait le gros du travail, les étudiants obtiennent leur diplôme avec des qualifications mais sans capacités. Le marché du travail ne sera pas aussi indulgent que la salle de classe.

Prévention par une évaluation authentique

Exigez une recherche primaire et une collecte de données. Concevez des projets exigeant des entretiens avec des membres de la communauté, des observations sur le terrain ou des enquêtes originales. L’IA peut aider à analyser des données, mais elle ne peut pas interviewer votre voisin ou documenter des phénomènes locaux. Une recherche authentique crée un apprentissage authentique.

Intégrez la réflexion et la métacognition. Demandez aux étudiants de documenter leur processus : Quels outils d’IA avez-vous utilisés et dans quel but ? Quelles suggestions avez-vous rejetées et pourquoi ? Comment votre réflexion a-t-elle évolué ? Cette transparence sert un double objectif — elle enseigne l’utilisation responsable de l’IA et révèle qui s’engage réellement avec le matériel.

Format présenter-et-défendre. Après la soumission du projet, planifiez de brèves sessions où les étudiants expliquent leur travail et répondent aux questions. Quelqu’un qui a vraiment créé son projet peut discuter de la méthodologie, défendre ses choix et développer ses conclusions. Quelqu’un qui a copié à partir de l’IA ? Il trébuchera lorsqu’on le poussera au-delà d’une compréhension superficielle.

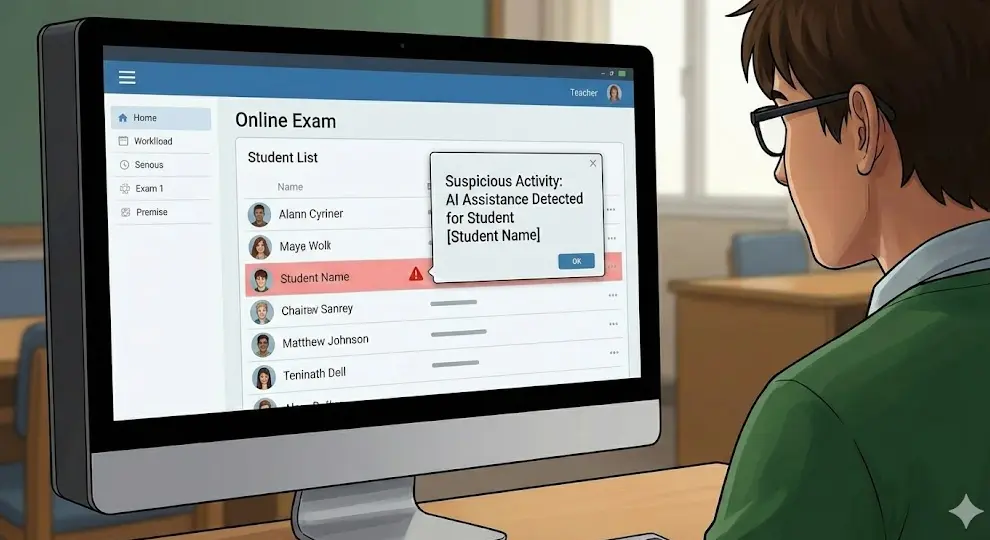

La technologie contre-attaque : La solution de surveillance par IA d’OnlineExamMaker

Alors que les stratégies pédagogiques constituent votre première ligne de défense, la technologie peut renforcer ces efforts — particulièrement pour les évaluations en ligne. OnlineExamMaker offre un système complet de surveillance alimenté par l’IA spécifiquement conçu pour maintenir l’intégrité des examens à l’ère numérique.

Créez votre prochain quiz/examen en utilisant l’IA dans OnlineExamMaker

Comment OnlineExamMaker protège l’intégrité académique

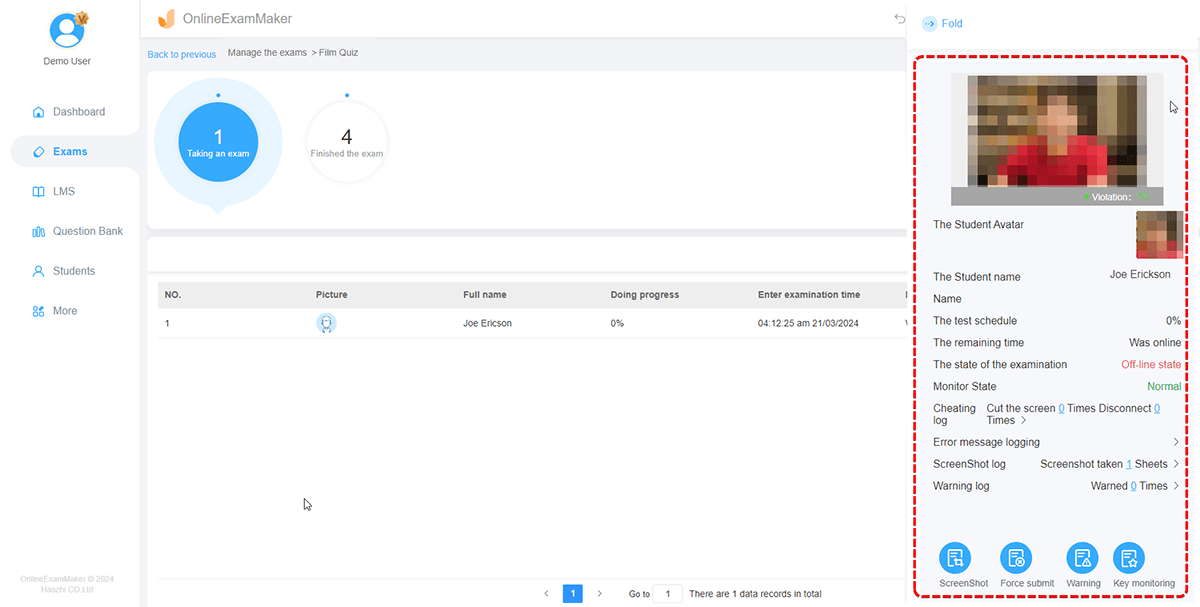

Technologie de reconnaissance faciale : Le système utilise une reconnaissance faciale alimentée par l’IA pour vérifier l’identité du candidat. Avant de commencer un examen, les étudiants téléchargent une photo de profil. Le système capture ensuite des images via webcam tout au long du test, les comparant à la photo stockée pour empêcher qu’une autre personne passe l’examen.

Surveillance webcam à 360 degrés : Une surveillance vidéo en temps réel capture l’intégralité du processus de test. L’IA analyse les modèles de comportement, détectant des activités suspectes comme :

- Baisser la tête ou se détourner (potentiellement en train de lire des documents cachés)

- Plusieurs visages apparaissant à l’écran (assistance non autorisée)

- Aucun visage détecté pendant de longues périodes (l’étudiant a quitté la zone de test)

- Détection audio pour la communication verbale ou l’utilisation d’IA activée par la voix

- Échecs de correspondance faciale (quelqu’un d’autre que l’étudiant enregistré passe l’examen)

Système d’alerte intelligent : Les administrateurs définissent des seuils pour les comportements suspects. Si un étudiant dépasse ces limites — par exemple, en regardant ailleurs plus de cinq fois — le système peut automatiquement soumettre son examen ou alerter les surveillants pour intervention.

Fonctionnalités du navigateur verrouillé : La plateforme applique le mode plein écran, empêchant les étudiants d’ouvrir des fenêtres, des onglets ou des applications supplémentaires. Elle peut détecter les tentatives de changement d’écran et limiter le nombre de fois où les étudiants peuvent quitter l’interface de l’examen.

Outils de randomisation : Pour empêcher le partage des réponses, OnlineExamMaker offre une randomisation des questions (tirées de banques de questions), une randomisation de l’ordre (mélange de la séquence des questions) et une randomisation des options (réarrangement des réponses à choix multiples). Chaque étudiant voit une configuration d’examen unique.

Tableau de bord de surveillance en temps réel : Les administrateurs peuvent surveiller tous les candidats en test simultanément via une console centralisée, visualisant les flux webcam en direct et recevant des alertes instantanées pour les activités suspectes. Après les examens, des journaux détaillés et les images capturées fournissent des preuves pour examen.

Meilleures pratiques de mise en œuvre

La technologie seule n’est pas une solution miracle. Pour une efficacité maximale, OnlineExamMaker recommande de permettre aux étudiants de se connecter 30 minutes à l’avance pour tester leurs webcams, ajuster l’éclairage et compléter la vérification faciale avant le début de l’examen. Cela empêche les difficultés techniques de faire échouer des étudiants légitimes aux contrôles d’identité.

Le système prend également en charge diverses stratégies d’évaluation que les éducateurs ont trouvées efficaces : limites de temps par question (réduisant l’opportunité de consulter l’IA), soumission automatique après de longues périodes hors ligne, et restrictions empêchant plusieurs connexions simultanées depuis le même compte.

Le plus important, une communication claire avec les étudiants sur les mesures de surveillance construit la confiance. Lorsque les étudiants comprennent ce qui est surveillé et pourquoi, ils sont plus susceptibles d’accepter ces mesures de sécurité comme étant justes plutôt qu’envahissantes. La transparence compte.

Réflexions finales : S’adapter à une nouvelle réalité

Prenons un peu de recul pour un moment. Nous assistons à un changement fondamental dans l’éducation, similaire à lorsque les calculatrices sont devenues omniprésentes ou lorsque l’internet a rendu l’information universellement accessible. Chaque fois, les éducateurs se sont adaptés — non pas en interdisant la technologie, mais en changeant ce que nous enseignons et comment nous l’enseignons.

Il en va de même pour l’IA. La recherche montre que 68 % des enseignants croient que l’IA générative aura un impact négatif sur l’intégrité académique, mais cette perspective pourrait manquer la vue d’ensemble. L’IA ne rend pas les étudiants tricheurs ; elle expose des faiblesses dans la façon dont nous évaluons l’apprentissage.

Si une IA peut réussir votre test ou devoir, peut-être que ce test ou devoir mesurait la mémorisation plutôt que la compréhension, la régurgitation plutôt que la pensée critique. La solution n’est pas de faire la guerre à l’IA — une guerre que nous perdrons inévitablement — mais de reconcevoir l’évaluation autour de compétences que l’IA ne peut pas reproduire : créativité, raisonnement éthique, recherche originale, perspicacité personnelle, application dans le monde réel.

Voici le paradoxe : les étudiants doivent apprendre à utiliser l’IA de manière responsable car leurs futures carrières l’exigeront probablement. Le Forum économique mondial liste la littératie en IA parmi les compétences critiques de la main-d’œuvre. Nous ne les préparons donc pas à un monde sans IA ; nous les préparons à un monde intégrant l’IA où ils auront besoin de jugement sur quand et comment utiliser ces outils.

Cela signifie des politiques claires, oui. Une surveillance robuste pour les examens à enjeux élevés, absolument. Mais plus fondamentalement, cela signifie repenser ce que nous valorisons dans l’éducation. Le processus plutôt que le produit. La pensée plutôt que les réponses. La croissance plutôt que les notes.

Les étudiants qui arrivent dans votre salle de classe aujourd’hui obtiendront leur diplôme dans un monde transformé par l’IA. Votre travail n’est pas de les protéger de cette réalité mais de les équiper pour la naviguer avec intégrité, pensée critique et compétence réelle. Le problème de la triche est réel, mais c’est aussi une opportunité — une invitation à construire quelque chose de meilleur que ce que nous avions auparavant.

Après tout, l’éducation a toujours été bien plus qu’empêcher la triche. C’est inspirer l’apprentissage. Et à l’ère de l’IA, cette mission compte plus que jamais.